Формула Хартли определяет количество информации, содержащееся в сообщении длины n.

Имеется алфавит А, из букв которого составляется сообщение:

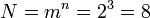

Количество возможных вариантов разных сообщений:

где N — возможное количество различных сообщений, шт; m — количество букв в алфавите, шт; n — количество букв в сообщении, шт.

Пример: Алфавит состоит из двух букв «B» и «X», длина сообщения 3 буквы — таким образом, m=2, n=3. При выбранных нами алфавите и длине сообщения можно составить  разных сообщений «BBB», «BBX», «BXB», «BXX», «XBB», «XBX», «XXB», «XXX» — других вариантов нет.

разных сообщений «BBB», «BBX», «BXB», «BXX», «XBB», «XBX», «XXB», «XXX» — других вариантов нет.

Формула Хартли определяется:

где I — количество информации, бит.

При равновероятности символов  формула Хартли переходит в собственную информацию.

формула Хартли переходит в собственную информацию.

Формула Хартли была предложена Ральфом Хартли в 1928 году как один из научных подходов к оценке сообщений.

Формула Шеннона

Когда события не равновероятны, может использоваться формула Шеннона.